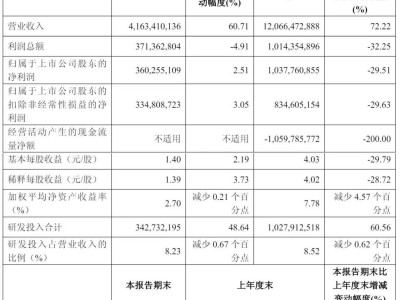

近日,百度推出的多語(yǔ)言文檔解析模型PaddleOCR-VL在開(kāi)源社區(qū)引發(fā)廣泛關(guān)注。該模型自開(kāi)源以來(lái),連續(xù)三天登頂Hugging Face趨勢(shì)榜首位,其強(qiáng)大的文檔解析能力獲得全球開(kāi)發(fā)者認(rèn)可。在最新發(fā)布的OmniDocBench基準(zhǔn)測(cè)試中,PaddleOCR-VL以92.6分的綜合成績(jī)位居全球第一,并在v1.5和v1.0兩個(gè)版本測(cè)試中均保持領(lǐng)先。

這款模型支持109種語(yǔ)言的文本、表格、公式和圖表識(shí)別,覆蓋全球主要語(yǔ)言體系及俄語(yǔ)、阿拉伯語(yǔ)、印地語(yǔ)等特殊語(yǔ)種。測(cè)試數(shù)據(jù)顯示,PaddleOCR-VL在文檔整體解析、文本識(shí)別、公式解析、表格結(jié)構(gòu)分析和閱讀順序預(yù)測(cè)等關(guān)鍵指標(biāo)上,均超越現(xiàn)有專用模型和通用多模態(tài)系統(tǒng)。特別是在處理手寫(xiě)文本和歷史文獻(xiàn)等復(fù)雜場(chǎng)景時(shí),模型展現(xiàn)出顯著優(yōu)勢(shì)。

技術(shù)實(shí)現(xiàn)方面,PaddleOCR-VL采用雙階段架構(gòu)設(shè)計(jì)。首階段通過(guò)PP-DocLayoutV2模型進(jìn)行布局分析,精準(zhǔn)定位文本塊、表格、公式等元素位置并預(yù)測(cè)閱讀順序;次階段利用PaddleOCR-VL-0.9B模型進(jìn)行細(xì)粒度識(shí)別。該模型結(jié)合NaViT風(fēng)格視覺(jué)編碼器與輕量級(jí)ERNIE-4.5-0.3B語(yǔ)言模型,在保證識(shí)別精度的同時(shí),將推理速度提升30%,GPU內(nèi)存占用降低40%。

訓(xùn)練數(shù)據(jù)構(gòu)建是模型性能的關(guān)鍵保障。研究團(tuán)隊(duì)通過(guò)公開(kāi)數(shù)據(jù)采集、合成數(shù)據(jù)生成、網(wǎng)絡(luò)數(shù)據(jù)抓取和內(nèi)部數(shù)據(jù)積累,構(gòu)建了超過(guò)3000萬(wàn)條訓(xùn)練樣本。采用專家模型標(biāo)注與大型多模態(tài)模型(ERNIE-4.5-VL、Qwen2.5VL)協(xié)同優(yōu)化的方式,有效解決了長(zhǎng)序列輸出的計(jì)算瓶頸問(wèn)題。特別設(shè)計(jì)的評(píng)估引擎能將文檔元素細(xì)分為20余個(gè)類別,實(shí)現(xiàn)訓(xùn)練性能的精準(zhǔn)分析。

實(shí)際測(cè)試表明,模型在處理中英文、韓語(yǔ)等語(yǔ)言時(shí)準(zhǔn)確率超過(guò)98%,復(fù)雜公式和圖表的識(shí)別準(zhǔn)確率達(dá)95%以上。當(dāng)測(cè)試蘇軾手札等繁體手寫(xiě)文獻(xiàn)時(shí),雖然出現(xiàn)少量識(shí)別誤差,但在清晰規(guī)范的手寫(xiě)文本處理中表現(xiàn)優(yōu)異。對(duì)于反光、褶皺等干擾因素,模型仍能保持較高識(shí)別率,僅在極端模糊情況下出現(xiàn)個(gè)別錯(cuò)誤。

在頁(yè)面級(jí)文檔解析測(cè)試中,PaddleOCR-VL在OmniDocBench v1.5測(cè)試集上創(chuàng)造多項(xiàng)紀(jì)錄:文本編輯距離降低至0.08,公式識(shí)別CDM分?jǐn)?shù)達(dá)0.9453,表格結(jié)構(gòu)TEDS評(píng)分突破92分。元素級(jí)識(shí)別測(cè)試顯示,該模型在多語(yǔ)言文本、手寫(xiě)體、復(fù)雜表格等場(chǎng)景的錯(cuò)誤率較同類模型降低40%以上。在512批次處理的推理測(cè)試中,其頁(yè)面吞吐量較基準(zhǔn)模型提升15.8%,token處理效率提高14.2%。

這款模型的創(chuàng)新性體現(xiàn)在三方面:雙階段架構(gòu)有效解決端到端模型的文本順序混亂問(wèn)題;動(dòng)態(tài)視覺(jué)編碼器實(shí)現(xiàn)高分辨率輸入下的高效處理;輕量化語(yǔ)言模型顯著降低部署成本。研究團(tuán)隊(duì)透露,該技術(shù)已應(yīng)用于金融合同解析、學(xué)術(shù)文獻(xiàn)處理、歷史檔案數(shù)字化等多個(gè)領(lǐng)域,未來(lái)將通過(guò)持續(xù)優(yōu)化提升模型在低質(zhì)量文檔和特殊字體場(chǎng)景下的適應(yīng)能力。