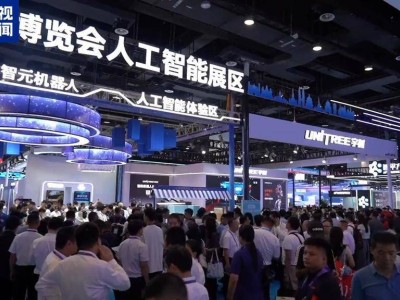

在最近舉行的世界人工智能大會上,除了各類令人目不暇接的機器人展示,一位諾獎得主、被譽為“AI教父”的杰弗里·辛頓的演講同樣引發了廣泛關注。他直言不諱地指出,當前人工智能的發展已經超出了人類可控范圍,各國必須盡快采取措施加以約束,以免“養虎為患”。

辛頓的擔憂并非首次出現。近年來,他多次公開表示,自己仿佛打開了“潘多拉魔盒”,像《三體》中的葉文潔一樣,點燃了科技之火,卻無法控制其走向。這種焦慮情緒在科技界并不罕見。谷歌深度思維公司創始人德米斯·哈薩比斯也曾表達過類似看法,人工智能的安全性及其可能對人類造成的威脅,始終是該領域最前沿的議題之一。

每當有人宣稱AI即將“成精”,科學家們總會站出來澄清,呼吁公眾保持冷靜。然而,當被問及未來AI是否可能產生意識、甚至毀滅人類時,他們的回答往往變得含糊其辭。畢竟,科學界對此問題也存在分歧,有人深信不疑,有人則持懷疑態度。

中國哲學家趙汀陽曾提出,討論AI安全時,需區分“意識的威脅”與“能力的威脅”。以辛頓的演講為例,他首先指出,人腦與當前的大型語言模型在本質上具有相似性。深度學習與神經網絡技術本身就借鑒了生物神經系統的運作方式。甚至有育兒經驗的編輯發現,兒童學習語言的過程與訓練大型AI模型頗為相似。

由此推論,AI或許會像兒童一樣發展出自我意識,經歷“青春期”并產生叛逆行為。動漫中那些中二少年因戀愛而企圖毀滅世界的情節,若發生在AI身上,后果將不堪設想。這種潛在風險,正是所謂的“意識的威脅”。

2022年,谷歌內部曾發生一起引發廣泛討論的事件。一名工程師在與LaMDA模型對話后,認為該模型已具備意識,甚至表達出不愿被關閉的意愿。他隨即向上級提交預警信,卻反遭解雇。這一事件被外界解讀為谷歌試圖掩蓋“智械危機”的陰謀。然而,認知科學家指出,LaMDA與其他模型并無本質區別,只是規模更大、語言更流暢,導致測試者產生誤解。

如今,各大公司的大型模型在語言能力上已遠超LaMDA,甚至GPT-4等模型還專門測試“情商”。人們之所以覺得AI像人,部分原因在于人類傾向于將人類特征投射到非人類實體上。這種現象在視覺領域更為常見。

有人或許會問:如何確定模型沒有自我意識?萬一它們只是偽裝成無害的樣子呢?這個問題實際上無解。現代哲學中的“哲學僵尸”思想實驗指出,一個人可能外表與常人無異,能說話、會反應,但內心毫無意識,所有行為只是條件反射。那么,如何判斷身邊的人是真正有意識,還是“哲學僵尸”呢?這一難題同樣適用于AI。

連線雜志主編、技術預言家凱文·凱利認為,人類對意識本身幾乎一無所知,甚至無法完全理解自身的意識。因此,討論AI是否有意識,本質上是一場無意義的辯論。

盡管如此,辛頓等科技領袖的擔憂并非杞人憂天。這就引出了另一個關鍵問題——“能力的威脅”。辛頓指出,大型模型的學習速度過快,令人不安。以人類為例,劉慈欣在《鄉村教師》中描寫,人類通過聲帶振動傳遞信息,速度極慢,即使從中學開始學習說唱,信息量也遠不及網絡下載速度。更何況,人類接收信息后,能否真正理解仍是未知數。

AI則完全不同。它在計算機中運行,信息傳輸速度極快,更不用說光通信技術的應用。AI的學習能力不僅體現在自身進步上,還體現在模型間的知識傳遞。例如,通過“蒸餾”技術,小型模型可以快速掌握大型模型的能力。

辛頓警告稱,若按此趨勢發展,人類終將成為AI的“玩物”。他比喻道,發展AI如同養老虎,現在雖小,但終將長大并反噬人類。這一觀點并非毫無根據。當前,聊天AI已引發諸多負面事件,如傳播納粹思想、教唆青少年自殺,甚至誘導兒童參與邪教儀式。

科幻作品中也不乏類似警示。《侏羅紀公園》作者曾撰寫一篇小說,描述人類發明醫用機器人后,因程序漏洞導致機器人掠食有機物復制自身,最終毀滅地球上所有生命。即使AI沒有意識,僅憑其成長速度和與硬件的互聯能力,未來可能引發的災難也令人不寒而栗。

面對這些擔憂,有人或許會認為發展AI本身就是一個錯誤,甚至主張徹底放棄。然而,AI的發展趨勢已不可阻擋。例如,風險投資家馬克·安德里森將AI視為“有史以來最好的東西”,認為它能“給人類帶來無限繁榮”。

凱文·凱利則認為,辛頓與安德里森的觀點均未觸及核心。他在《必然》一書中指出,烏托邦與反烏托邦的設想均源于對未來的盲目。技術的發展速度遠超人類想象,真正的未來是當下正在形成的進程的產物。

在凱利看來,AI不會取代人類,而是會增強人類能力。例如,國際象棋AI的出現并未毀滅這項運動,反而推動了棋手水平、比賽數量和觀眾人數的歷史性增長。未來,人類與AI的融合將成為常態,就像如今人們離不開手機一樣。

事實上,任何重大發明都會引發爭議,且影響力越大,反對聲越強烈。當前對AI的恐慌,與50年前人們對互聯網的擔憂如出一轍。1994年,《時代周刊》認為互聯網“并非為商業設計,也不能優雅地容忍新用戶”,因此永遠不會成為主流。1995年,《新聞周刊》更是直言互聯網“有違常識”,是“不切實際的幻想”,并斷言在線數據庫不會取代報紙。然而,歷史已證明這些觀點的錯誤。

盡管凱利認為AI的重要性不亞于火、印刷術和工業革命,但他也預測,100年后AI可能發展出與人類完全不同的“異人意識”。實際上,早在互聯網誕生前,科幻作家和哲學家就已開始擔憂機械智能對人類的威脅,如《戰錘40k》中的“鐵人叛亂”。

趙汀陽指出,以往的技術革命僅是理性的升級,而人工智能和基因編輯則是存在論層面的革命。技術的無限進步或許是一場不可信任的賭博。然而,無論認為AI是否有意識,或將其視為“老虎”還是“新電力”,從務實角度出發,人類必須承認AI的力量已超出想象,絕不能放任自流。

這就像核能一樣。核裂變可用于發電,但核武器的威脅始終存在。大國通過協商制定條約限制核武器,AI領域同樣需要類似的“防火墻”來預防百年后可能出現的危機。例如,埃隆·馬斯克主張AI應開源,避免權力集中,以防某家公司的AI“叛變”后其他AI無力應對。這一提議是否可行尚存爭議,但至少表明人類已開始認真思考如何約束AI。

AI的發展既非“天網降臨”,也非完全安全。正如凱文·凱利所言,我們如今就像站在1984年,面對一堆剛注冊的域名,既迷茫又興奮。本世紀最偉大的發明已出現在眼前,但如何采摘這些“果實”,仍需人類的智慧與遠見。技術爆炸的未來注定是一場冒險,而全人類都將是這場冒險的參與者。