當(dāng)新技術(shù)遇上老難題

如果給2025年下半年的AI行業(yè)選一個受關(guān)注的方向,視頻生成幾乎是繞不開的答案。在OpenAI發(fā)布Sora 2并上線App版本后,AI視頻的熱度幾乎以“病毒式”的速率在全球范圍內(nèi)迅速擴散開來。

但梳理產(chǎn)業(yè)發(fā)展的脈絡(luò),才會發(fā)現(xiàn),這并非是偶然的產(chǎn)品爆紅。背后,是過去兩年里視頻生成技術(shù)在畫面質(zhì)量、時序建模與可用性上的持續(xù)進步。Sora、Veo、通義萬相,無論是大公司還是創(chuàng)業(yè)公司,不斷累加的技術(shù)貢獻(xiàn),讓全球AI視頻相關(guān)能力的迭代節(jié)奏顯著加快。

更深層的影響,正在產(chǎn)業(yè)內(nèi)部逐步顯現(xiàn)。

當(dāng)模型的進步不再局限于畫面質(zhì)量本身,而是逐步覆蓋敘事能力、人物與風(fēng)格一致性、音畫同步、跨鏡頭邏輯延續(xù)等更接近工業(yè)化生產(chǎn)的關(guān)鍵要素。當(dāng)生成效果跨過“能看”的門檻,開始接近“可用”“好用”,AI視頻才真正進入大眾視野,也隨之成為當(dāng)前極具想象空間的賽道之一。

與此同時,視頻行業(yè)本身也在面臨著一種結(jié)構(gòu)性難題。

過去十余年里,圍繞視頻展開的產(chǎn)業(yè)始終是全球范圍內(nèi)增長最快、資本最密集、創(chuàng)新最活躍的領(lǐng)域之一。從影視娛樂、廣告營銷,到電商內(nèi)容、社交平臺與創(chuàng)作者經(jīng)濟,視頻逐漸成為信息、娛樂與商業(yè)的核心表達(dá)形態(tài)。但隨著行業(yè)成熟與競爭加劇,內(nèi)容生產(chǎn)被推向極限。短劇、電商與廣告進入“更快、更細(xì)、更大量”的階段,內(nèi)容更新周期被壓縮到小時級甚至分鐘級,而傳統(tǒng)制作鏈路所依賴的人力規(guī)模與制作周期,開始與這種節(jié)奏形成明顯錯位。

這種壓力在不同領(lǐng)域以不同形式顯現(xiàn):傳統(tǒng)影視與廣告仍高度依賴經(jīng)驗密集型人力,提案與試錯成本居高不下;MCN與電商側(cè)對高頻、碎片化素材的需求,已遠(yuǎn)超傳統(tǒng)拍攝與剪輯流程的承載能力;短劇與AI漫劇在走出早期粗放階段后,對角色、場景與鏡頭一致性提出更高要求;出海內(nèi)容則同時面臨速度與跨文化適配的雙重挑戰(zhàn)。

隨著內(nèi)容需求持續(xù)放大、AI視頻生成能力快速成熟,內(nèi)容產(chǎn)業(yè)的生態(tài)結(jié)構(gòu)開始發(fā)生變化。

一方面,創(chuàng)作門檻被顯著拉低。視頻不再只是少數(shù)專業(yè)團隊才能穩(wěn)定產(chǎn)出的內(nèi)容形態(tài),個人創(chuàng)作者與小團隊開始具備接近工業(yè)化的生產(chǎn)能力。

另一方面,圍繞視頻生成的新中間層正在出現(xiàn)——從創(chuàng)作工具、工作流平臺,到面向廣告、電商、短劇的垂直解決方案,越來越多公司開始將AI視頻作為底層能力重新設(shè)計產(chǎn)品形態(tài)。

這帶來了更多連鎖反應(yīng),比如平臺與創(chuàng)作者的關(guān)系也在被重塑,當(dāng)內(nèi)容成為可以反復(fù)生成、快速驗證、持續(xù)優(yōu)化的過程性資產(chǎn),視頻生產(chǎn)從一次性創(chuàng)作,逐步轉(zhuǎn)向可規(guī)模化運行的系統(tǒng)工程。

因此,最近這一年,國內(nèi)外涌現(xiàn)出大量圍繞AI視頻生成的產(chǎn)業(yè)鏈上下游的創(chuàng)業(yè)公司:有的從視頻生成能力本身出發(fā),重構(gòu)視頻制作的起點;有的圍繞創(chuàng)作者工作流,將AI融入腳本、分鏡與剪輯;還有的面向企業(yè)與行業(yè)場景,強調(diào)穩(wěn)定性與可規(guī)模化交付;出海方向,跨語種與本地化生成也成為重要突破口。

當(dāng)技術(shù)突破與國內(nèi)的規(guī)模化需求在同一時間點匯合,內(nèi)容行業(yè)逐漸形成一個清晰判斷:AI視頻生成已經(jīng)成為下一代內(nèi)容基礎(chǔ)設(shè)施的重要組成部分,更穩(wěn)定的技術(shù)和更快的工具遠(yuǎn)遠(yuǎn)不夠,創(chuàng)作者們需要的可能是一套更底層、可擴展的生產(chǎn)力方案。

創(chuàng)作的邊界,正被技術(shù)撕開

每家公司都在用自己的實際行動回應(yīng)這個趨勢。

以O(shè)penAI的Sora為代表,其策略更偏向通用能力展示:通過極高質(zhì)量、強視覺沖擊力的視頻生成,迅速打開公眾認(rèn)知,推動AI視頻進入大眾文化與社交傳播場景。Google的Veo,則延續(xù)其在多模態(tài)與生成模型上的研究優(yōu)勢,強調(diào)模型在長時序理解與復(fù)雜場景中的表達(dá)能力,更多體現(xiàn)為技術(shù)能力的前沿探索。

國內(nèi),更多公司從平臺生態(tài)出發(fā):有的將視頻生成能力與內(nèi)容分發(fā)、創(chuàng)作者體系和推薦機制相結(jié)合,試圖把AI視頻納入既有的創(chuàng)作—傳播閉環(huán);有的將生成能力賦能給視頻生產(chǎn)全流程,提升內(nèi)容供給效率。

這些路徑各有側(cè)重:有的優(yōu)先解決“能不能生成、生成得好不好看”,有的更關(guān)注“怎么玩、怎么傳播”。還有另一條逐漸顯現(xiàn)的路線,則是將視頻生成視為一種生產(chǎn)力能力。

而路徑之間的差別,本質(zhì)上是基于各家對好用還是好玩、B端還是C端的認(rèn)知差異。

在C端場景中,AI視頻更多承擔(dān)的是娛樂與表達(dá)功能,“好玩”“新鮮”“個性化”往往優(yōu)先于穩(wěn)定性,用戶對偶發(fā)的不一致與失控具有更高容忍度;而在廣告、電商、短劇等B端場景中,創(chuàng)作者與企業(yè)真正關(guān)心的,是鏡頭、人物與風(fēng)格能否長期保持一致,內(nèi)容是否可控、可復(fù)用,并能夠在高頻、高并發(fā)的生產(chǎn)節(jié)奏中穩(wěn)定輸出。

這也是當(dāng)前市場中一個容易被忽視的分野:許多視頻模型已經(jīng)能夠滿足C端的嘗鮮與創(chuàng)作需求,卻難以支撐B端對確定性與規(guī)模化的要求;而如果無法進入B端生產(chǎn)流程,AI視頻能力就很難真正轉(zhuǎn)化為生產(chǎn)力提升。

阿里選擇了一條更難,但也更能給整個行業(yè)帶來價值的路——將AI視頻生成做成行業(yè)級的基礎(chǔ)設(shè)施。12月17日,在阿里云飛天發(fā)布時刻上正式商業(yè)化發(fā)布通義萬相2.6(Wan2.6)。作為阿里在視頻生成領(lǐng)域的核心模型,萬相試圖回應(yīng)內(nèi)容行業(yè)從能生成走向可生產(chǎn)、從嘗鮮使用邁向規(guī)模化落地的趨勢變化。

通義實驗室產(chǎn)品負(fù)責(zé)人金璐瑤從多個維度向我們拆解了創(chuàng)作者在實際生產(chǎn)中最為關(guān)切的多鏡頭敘事、視頻參考生成與更穩(wěn)定的長時序輸出等能力,以及這些需求如何反向塑造模型能力的演進方向。

要讓AI視頻真正進入生產(chǎn)流程,首要前提是具備多鏡頭敘事能力。

在真實的視頻創(chuàng)作中,單個畫面的質(zhì)量從來不是最難的問題,真正的挑戰(zhàn)在于跨鏡頭的連續(xù)性——角色是否穩(wěn)定、場景是否連貫、時間與敘事是否成立。早期的視頻生成模型更擅長生成孤立的高質(zhì)量片段,一旦進入多機位、多景別的創(chuàng)作場景,人物細(xì)節(jié)漂移、動作邏輯斷裂、信息不一致等問題便會集中顯現(xiàn),這也是AI視頻長期停留在概念演示或單鏡頭素材階段的重要原因。

在Wan2.6中,多鏡頭能力被提升為模型層面的核心能力。相比“逐段生成、事后拼接”的路徑,通義萬相更強調(diào)在生成過程中對時間軸與鏡頭語言的整體建模:模型需要在一開始就明確“主體是誰”“空間如何變化”“敘事如何推進”,鏡頭切換才可能成為一個可控變量。為此,萬相在訓(xùn)練與推理階段持續(xù)強化主體一致性與時序建模,并支持自然語言分鏡指令,讓創(chuàng)作者能夠通過提示詞直接完成多鏡頭敘事調(diào)度。

這讓視頻生成具備了接近工業(yè)化生產(chǎn)所需的連續(xù)性基礎(chǔ)。

“在視頻生成中,時長始終是一項需要謹(jǐn)慎權(quán)衡的變量。”金璐瑤補充。

過短的視頻難以承載完整表達(dá),而一旦時長拉長,模型在一致性、時序穩(wěn)定性上的難度會迅速上升。行業(yè)中,大多數(shù)視頻模型仍將穩(wěn)定生成時長控制在4秒左右,再多一秒,技術(shù)挑戰(zhàn)往往呈指數(shù)級增長。

Wan2.6將可控生成時長穩(wěn)定在約15秒,并支持1080P輸出與聲畫同步。對廣告、電商展示、短劇分鏡等商業(yè)場景而言,15秒既能承載完整敘事,又不會顯著放大修改與控制成本,是一段“剛好可用”的內(nèi)容長度。

這次Wan2.6的發(fā)布中,文生圖能力也迎來了同步升級。模型在基礎(chǔ)生成之外,引入了對敘事結(jié)構(gòu)的理解,支持圖文混排輸入,從簡單提示中自動拆解故事并生成分鏡畫面,大幅提升故事型內(nèi)容的創(chuàng)作效率。結(jié)合多圖參考與商業(yè)級一致性控制,文生圖開始從“靈感草圖”走向可直接用于廣告與內(nèi)容制作的生產(chǎn)工具。

在滿足創(chuàng)作者最基本的生產(chǎn)需求之外,通義萬相還試圖進一步向前邁一步——繼續(xù)探索如何通過模型能力的持續(xù)演進,拓展創(chuàng)作的邊界,讓AI在表達(dá)、美學(xué)與敘事層面承擔(dān)更具主動性的角色。

“中式美學(xué)是萬相一直在堅持的理念。”金璐瑤告訴我們。在中文語境與中式美學(xué)上的持續(xù)投入,是萬相區(qū)別于許多海外模型的重要特征。通過與美院等機構(gòu)的合作,以及在預(yù)訓(xùn)練與評測階段引入大量中式審美素材,模型在人物氣質(zhì)、風(fēng)格表達(dá)與文化細(xì)節(jié)上的表現(xiàn)更貼近本土創(chuàng)作需求。這種優(yōu)化并非一次性完成,而是通過評測體系、客戶反饋與強化學(xué)習(xí)不斷迭代。

真實需求不斷抬高對技術(shù)能力的要求,而技術(shù)細(xì)節(jié)的持續(xù)突破,又反過來釋放出新的生產(chǎn)效率,通義萬相正是在這樣的反饋循環(huán)中演進。正如通義實驗室產(chǎn)品負(fù)責(zé)人金璐瑤所說:“我們一直堅持一件事情,就是效果好大于一切。”

當(dāng)效率提升,當(dāng)周期縮減,

當(dāng)人員不再冗余

不用太久,一年,甚至只是半年之前,視頻與影視制作相關(guān)行業(yè)的從業(yè)者,大多還難以想象自己的工作效率可以被成倍提升。

效率提升,是內(nèi)容生產(chǎn)方式重構(gòu)的直接結(jié)果。在傳統(tǒng)制作體系中,創(chuàng)意、執(zhí)行與后期被拆分為多個線性環(huán)節(jié),每一步都需要由特定崗位承接。在高度分工的模式下,流程只能順序推進,往往需要前一環(huán)節(jié)完全落實后才能進入下一步,既拉長了整體制作周期,也造成了大量重復(fù)與冗余的人力投入。

而當(dāng)AI視頻生成開始介入創(chuàng)作前端,許多原本需要跨崗位協(xié)作才能完成的工作,被壓縮進同一個創(chuàng)作界面之中。編劇、導(dǎo)演、剪輯、美工……過去傳統(tǒng)崗位的邊界,在慢慢變得模糊。腳本可以直接轉(zhuǎn)化為分鏡,分鏡可以快速生成可視化素材,剪輯與美術(shù)調(diào)整也不再依賴漫長的后期流程。崗位之間的交接成本被顯著降低,創(chuàng)作者開始更多地圍繞最終效果進行整體判斷,而不是各自守在固定工序上。

這進一步帶來的變化是,當(dāng)內(nèi)容生產(chǎn)從線性流程,轉(zhuǎn)向以模型為核心的并行與即時生成,效率提升并不會平均分布在所有人身上。最先發(fā)生變化的,往往是那些本身就承受著高頻產(chǎn)出壓力、對成本和周期高度敏感的場景。

這類場景的共同是:一方面要保證持續(xù)、規(guī)模化生產(chǎn)內(nèi)容;另一方面其創(chuàng)意需要被快速驗證、反復(fù)迭代。因此,AI視頻帶來的效率提升,往往最先影響短劇、漫劇、電商內(nèi)容、出海創(chuàng)作工具等領(lǐng)域。

以廣告和電商為例,過去一次完整的創(chuàng)意驗證,往往需要經(jīng)歷腳本、分鏡、拍攝、后期等多個環(huán)節(jié);而在引入視頻生成能力后,創(chuàng)作者可以更早地把想法轉(zhuǎn)化為可視化內(nèi)容,用于內(nèi)部討論、客戶提案或A/B測試。AI參與到創(chuàng)意形成的前端階段,顯著壓縮了從想法到內(nèi)容的距離。

而當(dāng)穩(wěn)定、可規(guī)模化的視頻生成能力向外開放,新的工具平臺、創(chuàng)作社區(qū)與內(nèi)容服務(wù)開始生長,創(chuàng)作者能夠置身于一個不斷自我擴展的AI創(chuàng)作生態(tài)之中。而這一點,恰恰是許多視頻生成能力提供商尚未充分意識到的。

在AI漫劇與短劇領(lǐng)域,巨日祿是目前最具代表性的實踐者之一。巨日祿是一家面向動漫制作方的AI短劇/漫劇工具平臺,已被大量內(nèi)容方用于漫劇創(chuàng)作并在主流平臺落地應(yīng)用。

通過場景化調(diào)用通義萬相模型,巨日祿將圖片與視頻生成能力嵌入創(chuàng)作工具鏈,大幅降低了AI在內(nèi)容生產(chǎn)中的使用門檻。

在巨日祿創(chuàng)始人杰夫看來,通義萬相2.6在主體一致性、指令遵循、運鏡與人物表現(xiàn)上的穩(wěn)定性,“讓我們可以全天候、規(guī)模化使用”。巨日祿agent也已從創(chuàng)新實驗轉(zhuǎn)變?yōu)榭芍苯油懂a(chǎn)的爆款劇創(chuàng)作智能體,效率再提成5-8倍。

成立于2016年的樂我無限,是一家以出海為核心方向的社交與內(nèi)容產(chǎn)品公司,近年來將業(yè)務(wù)延伸至AI視頻與創(chuàng)作工具領(lǐng)域,面向海外市場推出了多款視頻創(chuàng)作工具。

其中,萬相模型的多模態(tài)生成能力讓旗下創(chuàng)作平臺Ima Studio (www.imastudio.com)能夠支持海外創(chuàng)作者快速生成高質(zhì)量、風(fēng)格多樣的AI視頻內(nèi)容,顯著提升了社區(qū)內(nèi)容密度與創(chuàng)作質(zhì)量。這一能力也幫助樂我在冷啟動階段吸引了海外KOL、藝術(shù)家等核心創(chuàng)作者,并通過硅谷線下Workshop、高校合作等方式,逐步構(gòu)建起“技術(shù)—內(nèi)容—社區(qū)”的正向循環(huán)。

樂我無限與巨日祿的實踐表明,以通義萬相為代表的穩(wěn)定型AI視頻基礎(chǔ)設(shè)施,正在顯著降低小團隊乃至個體創(chuàng)作者的創(chuàng)作門檻。原本依賴多崗位協(xié)作完成的工作,被逐步內(nèi)化為模型能力,使創(chuàng)作者能夠在有限人力條件下,仍然維持穩(wěn)定的敘事質(zhì)量,并持續(xù)輸出成體系的內(nèi)容。

只有當(dāng)?shù)讓有Ч銐蚩煽浚珹I視頻生成才能從“好玩”走向“好用”,并在此之上,為更大的創(chuàng)作自由與產(chǎn)業(yè)創(chuàng)新留出空間。

人人都能當(dāng)導(dǎo)演的時代

從好玩走向好用,真正的分水嶺,在于它是否能夠進入穩(wěn)定、可重復(fù)的生產(chǎn)流程。

企業(yè)和創(chuàng)作者更關(guān)心的是:生成結(jié)果是否可控、是否穩(wěn)定、是否能減少反復(fù)抽卡和人工返工的成本。相比速度或單次驚艷效果,穩(wěn)定性才是進入生產(chǎn)流程的前提。

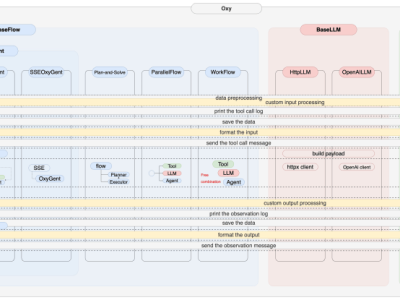

從創(chuàng)作者視角看,他們同時還需要更完整的服務(wù)體系。依托阿里云的大模型服務(wù)與應(yīng)用開發(fā)平臺百煉,萬相并不是一個孤立的生成工具,而是可以被嵌入到企業(yè)既有的內(nèi)容生產(chǎn)與業(yè)務(wù)流程中。

這些能力能夠在真實場景中保持穩(wěn)定可用,與阿里云長期作為產(chǎn)業(yè)級基礎(chǔ)設(shè)施所積累的工程能力密切相關(guān)。作為全球領(lǐng)先的全棧人工智能服務(wù)商,阿里云在算力供給、數(shù)據(jù)治理、模型服務(wù)以及大規(guī)模并發(fā)調(diào)度等方面積累了成熟體系,使視頻生成模型得以在真實生產(chǎn)環(huán)境中持續(xù)運行,而不只是停留在實驗室或小規(guī)模演示階段。

從更長的時間尺度看,阿里對人工智能的系統(tǒng)性投入可以追溯到十多年前。早在2010年代初,阿里就開始圍繞搜索、推薦、語音與計算機視覺等方向布局AI能力;2016年起,阿里巴巴內(nèi)部陸續(xù)成立人工智能實驗室在機器學(xué)習(xí)、計算機視覺、自然語言處理、多模態(tài)等方向持續(xù)投入。正是在這樣的技術(shù)積累之上,阿里云逐步構(gòu)建起從模型訓(xùn)練、部署到服務(wù)化調(diào)用的完整鏈路。

長期專注、搭配產(chǎn)業(yè)服務(wù)、穩(wěn)定基礎(chǔ)設(shè)施的組合,使得以通義萬相為代表的模型和服務(wù)能夠沿著既定技術(shù)路線持續(xù)演進,在穩(wěn)定性、可控性與規(guī)模化能力上不斷逼近真實生產(chǎn)需求,不斷提升創(chuàng)作者的生產(chǎn)力效率。

過去,鏡頭語言、敘事節(jié)奏、美術(shù)風(fēng)格與制作經(jīng)驗,高度集中在少數(shù)專業(yè)團隊之中;而當(dāng)這些能力被逐步編碼進模型,創(chuàng)作者所需要掌握的,正在從具體技法轉(zhuǎn)向判斷、創(chuàng)意與取舍本身。這意味著,任何有創(chuàng)意的人,都可以通過AI視頻生成的技術(shù)和服務(wù),實現(xiàn)自己的內(nèi)容創(chuàng)作,不再由“是否會用專業(yè)工具”決定。

這種變化的意義,類似于從專業(yè)級影像軟件走向大眾化創(chuàng)作工具的歷史拐點——正如數(shù)碼相機取代膠片、智能手機取代專業(yè)相機、模板化剪輯取代復(fù)雜后期一樣,AI視頻生成正在把一整套專業(yè)制作能力,壓縮為可被普通人調(diào)用的基礎(chǔ)設(shè)施。

在降低門檻的同時,創(chuàng)作這件事本身也將具備更大的規(guī)模與更長的生命力。

或許,視頻生成的終點并不是替代創(chuàng)作者,而是讓創(chuàng)作者把精力更多投入到真正有價值的部分——創(chuàng)意、敘事與判斷本身。